OmniGen2是什么?

OmniGen2是智源研究院推出的开源多模态生成模型,具备文本生成图像、图像编辑、上下文图像生成与视觉理解等核心能力。其采用图文解耦架构,结合ViT与VAE双编码器策略,增强模型的灵活性与一致性。OmniGen2引入图像自我反思机制与OmniContext评估基准,解决多模态任务中一致性难题。模型已开源全部权重、代码与数据构建流程,支持Gradio在线试玩与本地部署,推动多模态AI从研究走向实用。

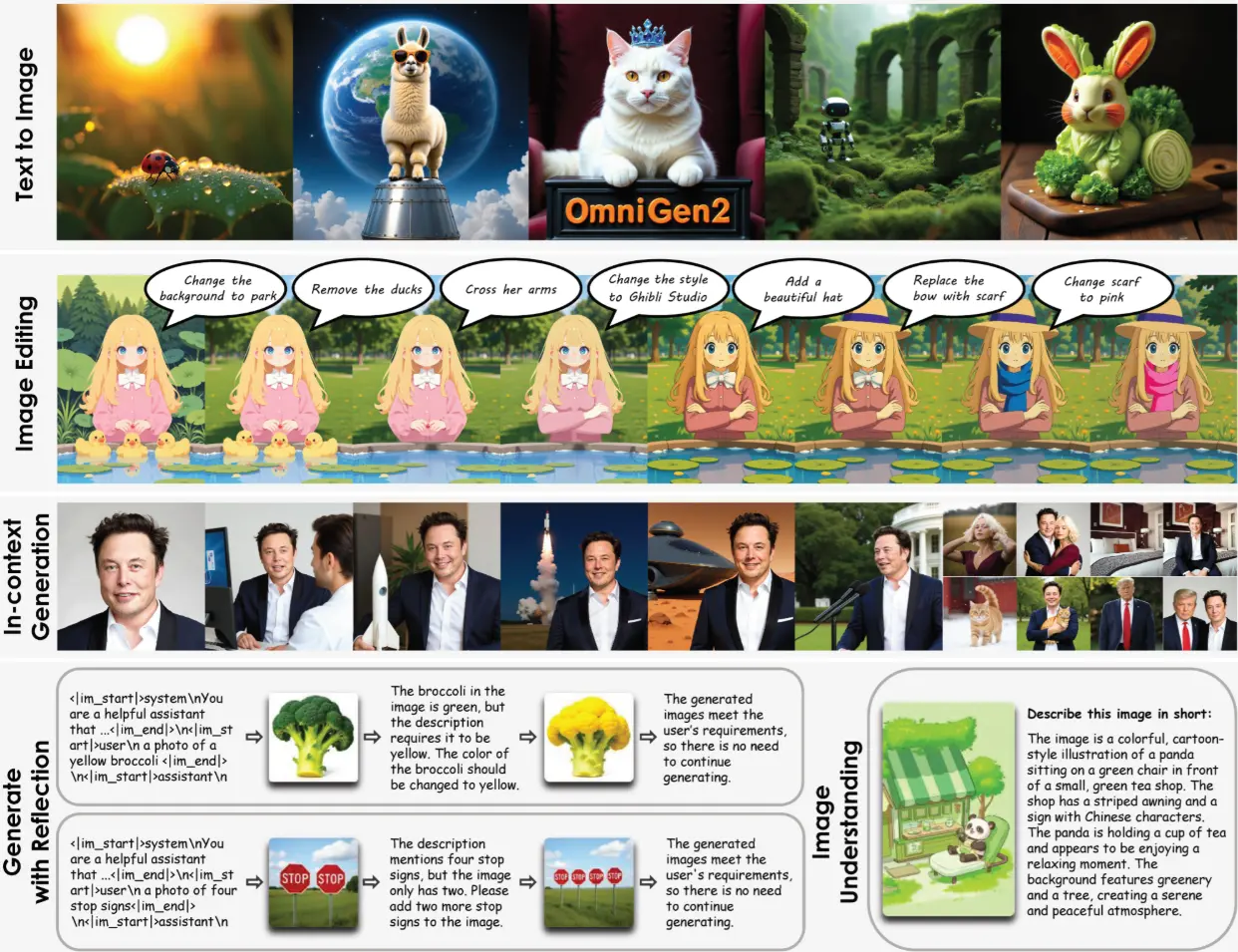

OmniGen2 的主要功能

- 视觉理解:继承了 Qwen-VL-2.5 强大的图像内容解读和分析能力。

- 文本生成图像:根据自然语言描述生成高质量、语义一致的图像。

- 图像编辑:通过文字指令对图像进行精确修改,如增删物体、换背景等。

- 上下文图像生成:结合多张参考图像的元素,生成结构与语义统一的新图像。

- 任意比例图像生成:支持生成 1:1、2:1、3:2 等任意比例的图像。

OmniGen2 的应用场景

- 创意设计与视觉内容生成

设计师可通过文本描述快速生成概念图、场景草图或角色形象,加速创意流程。 - 图像编辑与后期处理

支持基于自然语言的精细化图像编辑操作,如去除背景、修改颜色、调整表情等,适用于图像修图、广告制作等场景。 - AI辅助内容创作(AIGC)

结合文本与图像上下文生成,服务于动画制作、游戏开发、短视频创作等内容生成平台。 - 电商与商品展示优化

自动生成商品展示图或场景化图像,实现一图多用,提升转化率与视觉吸引力。 - 教育与科研可视化

教育场景中通过生成图像直观展示教学内容;科研中用于生成仿真图像、可视化复杂数据。 - 人机交互与虚拟助手

作为多模态 AI 接口的一部分,理解用户输入图像与语音,生成反馈图像,提升交互体验。

OmniGen2 的项目信息

OmniGen2模型权重、训练代码、训练数据全面开源,链接如下:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...